Abstract

肌萎缩性侧索硬化症(ALS)患者往往难以通过语言和行为来表达意图,无法正常地与外部世界沟通,严重影响生活质量。脑机接口(BCI)的方式能够辅助ALS患者与外部世界进行交流而受到广泛的关注,但是可移动性差的设备在使用中给患者带来不便。为了改善BCI系统的便携性,本文提出了一种基于Hololens2的可穿戴式P300字符拼写系统(MR-BCI)。本系统使用Hololens2混合现实设备呈现范式,OpenBCI设备采集脑电信号,Jetson Nano嵌入式计算机处理数据。同时,为了优化系统的性能,本文提出一种轻量化的卷积神经网络方法应用于嵌入式计算机进行实时分类。结果表明,与基于计算机显示器的拼写系统(CS-BCI)相比,MR-BCI诱发的P300振幅增加,离线和在线模式的准确率分别提高1.7%和1.4%,在线模式的信息传输速率提高了0.7 bit/min。本文提出的MR-BCI在保证系统性能的基础上,实现了可穿戴式BCI系统,对BCI的临床应用具有积极的作用。

Keywords: 脑机接口, 增强现实, P300拼写器, 可穿戴式

Abstract

Patients with amyotrophic lateral sclerosis ( ALS ) often have difficulty in expressing their intentions through language and behavior, which prevents them from communicating properly with the outside world and seriously affects their quality of life. The brain-computer interface (BCI) has received much attention as an aid for ALS patients to communicate with the outside world, but the heavy device causes inconvenience to patients in the application process. To improve the portability of the BCI system, this paper proposed a wearable P300-speller brain-computer interface system based on the augmented reality (MR-BCI). This system used Hololens2 augmented reality device to present the paradigm, an OpenBCI device to capture EEG signals, and Jetson Nano embedded computer to process the data. Meanwhile, to optimize the system’s performance for character recognition, this paper proposed a convolutional neural network classification method with low computational complexity applied to the embedded system for real-time classification. The results showed that compared with the P300-speller brain-computer interface system based on the computer screen (CS-BCI), MR-BCI induced an increase in the amplitude of the P300 component, an increase in accuracy of 1.7% and 1.4% in offline and online experiments, respectively, and an increase in the information transfer rate of 0.7 bit/min. The MR-BCI proposed in this paper achieves a wearable BCI system based on guaranteed system performance. It has a positive effect on the realization of the clinical application of BCI.

Keywords: Brain-computer interface, Augment reality, P300-speller, Wearable

0. 引言

脑机接口(brain-computer interface,BCI)是一种允许用户在不需要任何肌肉活动的情况下与环境进行交互的技术[1]。BCI系统常用的方法是通过对所识别特定任务的脑电图(electroencephalography,EEG)进行特征提取后,将它转换成驱动指令来控制输出[2],并且由于EEG具有较高的时间分辨率、无创性和可移植性而被广泛使用[3]。当前的研究中,主要任务是准确获得EEG信号中的P300成分[4],P300是与认知功能相关的特殊诱发电位,基于P300的字符拼写系统可以评估和预测个人行为[5]。

传统的P300字符拼写系统由计算机显示器(computer screens,CS)、脑电仪和台式机组成,分别用来呈现刺激范式以及采集和处理EEG信号[6]。随着对BCI的深入研究,字符拼写系统的性能正在不断提升,但是众多沉重的配件给系统的携带和安装带来困难,同时复杂的设备结构并不考虑其系统的集成度[7],这限制了BCI的便携性和适用范围。如何在保证BCI系统性能的基础上增加其便携性,成为了BCI技术迈向实际应用亟待解决的关键问题。

头戴式显示器(head-mounted displays,HMD)提供视觉刺激可以令字符拼写系统摆脱传统的CS设备。Kerous等[8]实现了基于增强现实(augment reality,AR)的P300拼写器用于双端文本通信。研究表明,AR设备可以同时在屏幕中容纳刺激界面和周围环境,用户观看由摄像头捕捉的实时视频,然后用虚拟信息通过HMD进行增强。但是受到摄像头视场的限制,用户与真实世界的交互不直观。Ke等[9]利用混合现实(mixed reality,MR)设备呈现稳态视觉诱发电位范式控制机械臂。研究发现,MR设备中用户对真实世界的第一人称视图被半透明屏幕上显示的虚拟信息增强,真实世界的物体直接通过透镜传入人眼,没有视觉偏差且分辨率极高。目前,基于MR的Hololens2设备呈现P300刺激范式的系统性能仍需探究。

脑电采集设备通常为了信号的采集精度而牺牲体积[10]。Neuroscan脑电系统(Neuroscan,美国)是业界最先进、应用最普遍的脑电采集设备之一[11],但是它配有沉重的电源和放大器,成为了便携式BCI系统的阻碍。此外,用于信号处理的计算机也不利于携带。因此,脑电采集和信号处理设备的选择成为了实现系统便携性的重要问题。

针对以上问题,本文提出了一种基于Hololens2的可穿戴式P300字符拼写系统(MR-BCI),系统包括Hololens2(Microsoft,美国)、OpenBCI开发板(OpenBCI,美国)和Jetson Nano嵌入式计算机(NVIDIA,美国)等硬件,以及实时识别EEG的分类方法。系统使用体积小、重量轻的OpenBCI对EEG进行采集,Frey[12]使用OpenBCI与高精度放大器设备进行比较发现,两者采集的信号精度较为接近。Jetson Nano嵌入式计算机可对数据进行记录和处理,而针对其算力而改进的轻量化EEG实时分类方法可满足本系统的运算需求,提高了开发系统硬件环境下的局限性。

1. 系统设计

1.1. 系统范式设计

范式由6×6的矩阵组成,六个绿色正方形图片为一组,覆盖在当次强化字符的上面。为了避免邻接闪烁[13],实验设计了真实和虚拟两个字符矩阵。真实矩阵(见图1a)按照字符顺序进行排列;虚拟矩阵(见图1b)将字符顺序完全打乱,将原本相邻的两个字符的位置尽可能放远,形成一个新的矩阵。虚拟矩阵中行和列的每一次闪烁,都相当于真实矩阵中不相邻的六个图片闪烁。

图 1.

P300-speller paradigm

P300范式

a. 真实矩阵;b. 虚拟矩阵;c. MR-BCI系统中的范式;d. MR-BCI 视场角

a. actual matrix; b. virtual matrix; c. paradigm in MR-BCI; d. field angle in MR-BCI

为了探究MR-BCI和CS-BCI系统之间的差异,范式分别呈现在微软Hololens2设备(2 K分辨率,60 Hz刷新率)和计算机显示器(华硕VA24 DCP,23.8英寸,60 Hz刷新率)上。MR-BCI系统中,范式由Unity3D引擎设计,背景和字符分别设置为透明和白色(见图1c);CS-BCI系统的范式由E-prime软件生成,背景和字符分别为黑色和灰色。矩阵的水平视场角为28°,垂直视场角为24.4°(见图1d)。

1.2. 系统识别算法设计

传统的卷积神经网络(convolutional neural networks,CNN)层数较深容易过多地学到数据间的细节特征,同时深层的CNN在数据分析的过程中对计算机的性能要求较高[14]。因此本文基于CNN提出一种参数量少的轻量化P300识别方法,不仅能够避免深度网络训练小数据集时出现过拟合现象,而且能够使低算力的嵌入式计算机得以实时处理EEG数据。

首先对数据进行预处理,使用四阶巴特沃斯带通滤波器去除信号的噪声和伪迹,截止频率为0.1~30 Hz。对当前标签的–200~800 ms的数据进行截断,使用前200 ms的数据进行基线校正。为了更好地识别特征间的差异,使用目标和非目标刺激之间差异的参数(通常用r2表示)衡量系统性能。根据r2值的结果,提取刺激开始后100~700 ms的脑电数据作为特征向量的时间窗口,对数据进行降采样处理,每3个数据选取1个。特征向量的大小为200 × 7,输入网络的数据尺寸为57 600 × 200 × 7。

特征提取模块由两个部分组成,每个部分都有一个卷积层用于提取信号的抽象特性。卷积层的卷积核大小分别为1 × 70和7 × 1,用以提取EEG信号的时域和空域特征。为了加快模型的收敛速度,在第一个卷积层和整流层中间加入批归一化层。每个卷积层都有一个ReLU激活函数将小于0的特征变为0,以降低计算复杂度。特征提取后,使用全连接层进行线性展开,Softmax层用于计算P300出现的概率,使用交叉熵来判定实际输出与期望输出的接近程度(见图2)。

图 2.

CNN network model

CNN网络模型

2. 系统测试

2.1. 受试者

本研究从长春理工大学本科生和研究生中招募16名志愿者,包括11名男性和5名女性,年龄22~26岁。所有受试者的母语都为汉语,都熟悉范式中使用的西方字符,且均无视力或听力障碍。

2.2. 实验过程

首先搭建MR-BCI系统和CS-BCI系统。MR-BCI系统的设备间通过无线Wifi连接。Hololens2生成的标签通过UDP从Hololens2的WiFi模块发送到OpenBCI,使用Wifi模块将采集到的EEG数据和标签传输到Jetson Nano进行处理,然后将结果反馈到Hololens2设备(见图3a)。CS-BCI系统的设备间通过有线局域网(local area network,LAN)连接。CS生成的标签发送到NeuroScan放大器,放大器对信号进行采集后将数据和标签发送到台式机,台式机进行信号处理和分析后将结果反馈给CS设备输出字符(见图3b)。

图 3.

The system hardware structure in the experiment

实验中系统硬件结构

a. MR-BCI系统;b. CS-BCI系统

a. MR-BCI system; b. CS-BCI system

在电极选择的过程中,Hololens2背部的电池会遮挡头部较小的受试者的枕叶区域,影响枕叶信号的采集(见图4a-b)。MR-BCI和CS-BCI实验分别记录F3、Fz、F4、C3、Cz、C4和Pz处7个通道的数据,接地电极为AFz,右侧乳突放置参考电极。考虑到受试者的舒适度,本研究未使用水平和垂直眼电(见图4c)。信号的采样率为1 000 Hz,带通滤波0.1~100 Hz。CS-BCI实验中,受试者的眼睛与CS设备保持70 cm的距离;MR-BCI实验中,需要将Hololens2佩戴于脑电帽的外部。

图 4.

Electrode selection

电极选择

a. 设备佩戴背视图;b. 设备佩戴侧视图;c. 电极位置

a. device wearing back view; b. device wearing side view; c. electrode position

离线实验过程中,受试者分别对MR-BCI和CS-BCI系统进行实验,共进行2组实验。每6个矩形的闪烁被称为子试验。其中包含和不包含目标字符的闪烁分别被定义为目标子试验和非目标子试验。一组实验共闪烁10个序列,每个序列有15次试验,每12次闪烁称为一次试验,一次试验包含2个目标子试验和10个非目标子试验。每次闪烁绿色图片的呈现时间为100 ms,刺激时间间隔为75 ms(见图5)。

图 5.

Experimental process

实验过程

2.3. 系统性能评估指标

为了分析EEG信号中可能包含的P300部分,本文利用r2值对时间窗口进行选择,见式(1):

|

1 |

其中N1和N2分别代表目标和非目标刺激的样本量;x1和x2分别代表目标和非目标刺激的特征向量,特征向量大小用PN × CN表示,PN表示所选时间窗口内的样本点,CN表示通道数。

受试者的字符识别准确率是评价BCI系统真实性能的重要指标,计算公式(2)如下:

|

2 |

其中TP为预测为正的正样本,TN为预测为负的负样本,FP为预测为正的负样本,FN为预测为负的正样本。

采用信息传输速率(information transfer rate,ITR)评估BCI系统的通信性能[15],见式(3):

|

3 |

其中P表示识别字符正确率,T表示识别字符所需的时间,N表示目标刺激的数量(N = 36)。

3. 系统性能与结果分析

3.1. ERPs结果与分析

ERP反映了认知过程中大脑神经电生理的变化,分析ERP波形能锁时性地反映认知的动态过程。图6显示了MR-BCI和CS-BCI系统目标刺激诱发的ERP成分。在300~500 ms内出现正峰值,被确定为P300成分。结果显示,MR-BCI系统诱发的P300振幅高于CS-BCI。我们认为该结果是由于视觉异常刺激的定向反应和与认知相关的附加效应所造成的。MR-BCI增加了认知任务中的“新颖性”,使受试者能够积极地处理信息从而诱发更明显的P300成分。

图 6.

Superimposed grand-averaged waveforms induced by target (T) and non-target (F) stimuli in MR-BCI and CS-BCI

MR-BCI和CS-BCI中目标(T)和非目标(F)刺激诱发的叠加平均波形

100~200 ms、200~350 ms之间分别观察到一个具有负峰值和正峰值的ERP波形,我们认为是N1、P2成分,N1、P2受空间注意力的影响进行反应识别加工。Gao等[16]研究了ERP对三维(3 dimensional,3D)物体透视图的二维(2 dimensional,2D)渲染反应,发现3D对象诱发的N1、P2振幅更大。Cauquil[17]将2D和3D刺激诱发的ERP进行比较,发现3D诱发的N1、P2振幅明显大于2D。Cattan[18]通过在VR和CS环境中呈现P300范式的比较发现,VR设备能引起更大更宽的P2。因此我们认为,MR-BCI系统中N1、P2成分的产生与Hololens2的3D成像方式有关。Hololens具有空间信息显示的特性,可能会使受试者对空间信息识别和编码的效率更高,从而诱发更大振幅的N1、P2成分。对比分析发现,CS-BCI系统能观察到N1、P2的趋势,但是并不明显。

ERP特征差异主要存在于两个系统间的100~500 ms范围内,可以观察到在170~220 ms之间,MR-BCI系统的r2值达到最低,有明显的负偏转;在350~500 ms之间,MR-BCI系统的r2值大于CS-BCI(见图7)。结果表明,MR-BCI的r2值更高,MR-BCI在时间序列上相较于CS-BCI约有50 ms的延迟,证明系统内目标和非目标刺激存在差异。

图 7.

r2 values of CS-BCI and MR-BCI systems

CS-BCI与MR-BCI系统的r2值

3.2. 系统性能分析

由于EEG信号的信噪比低,若要保证系统的稳定性就要对受试者进行重复刺激,但是增加刺激次数会降低字符的输出速度。系统的叠加次数应该兼顾其准确性和字符输出速度,因此本文对所有受试者在两个系统中的平均准确率进行了分析(见图8)。数据经过1~15次叠加平均,采用4折交叉验证的方法验证每名受试者的准确率。结果显示,在MR-BCI和CS-BCI系统中,经过3次叠加的平均准确率分别为84.1%和82.8%,经过5次叠加的平均准确率分别为95.3%和93.6%,经过15次叠加的平均准确率分别为98.8%和98.9%。结果表明,准确率随叠加次数的增加而增大,由于经过5次叠加的准确率均超过90%,所以我们认为5次试验系统能够在叠加次数较少的基础上达到较为稳定的准确率。

图 8.

Mean accuracy and standard deviation of all subjects in MR-BCI and CS-BCI systems

所有受试者在MR-BCI和CS-BCI系统的平均准确率和标准差

标准差可以衡量数据与其平均值之间的差异,为了评估系统的稳定性,我们分别计算了两个系统的标准差(见图8)。结果显示,MR-BCI和CS-BCI的准确率经过5次叠加的标准差分别为8.74%和8.11%,经过15次叠加的标准差分别为4.78%和4.49%。结果表明,CS-BCI系统的稳定性高于MR-BCI,同时随着叠加次数的增加,标准差逐渐减小,系统的稳定性得以提高。

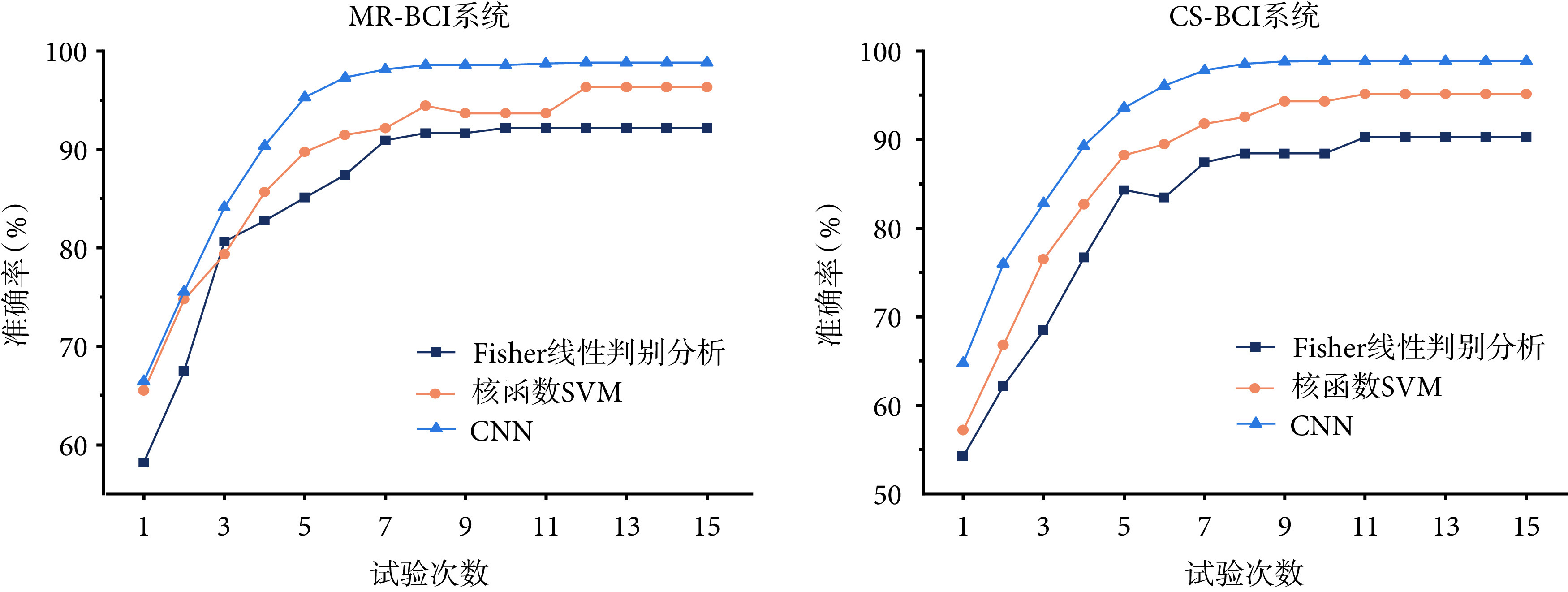

为了对本文提出的CNN模型性能进行测试和分析,图9比较了CNN、核函数支持向量机(support vector machines,SVM)和Fisher判别分析(functional linear discriminant analysis,FLDA)的平均准确率。结果显示,MR-BCI和CS-BCI系统经过5次叠加,CNN的平均准确率为95.3%和93.6%,核函数SVM的平均准确率为89.3%和87.3%,FLDA的平均准率为85.9%和82.2%。在同时使用本文提出的CNN方法进行分类的情况下,MR-BCI比CS-BCI的准确率提高了1.7%。本系统提出的CNN方法的准确率要高于两种传统的机器学习方法,实验证明本方法适用于处理小数据集,模型具有更快的拟合速度。

图 9.

Average accuracy of three classification methods in different stack folds

三种分类方法在不同叠加次数的平均准确率

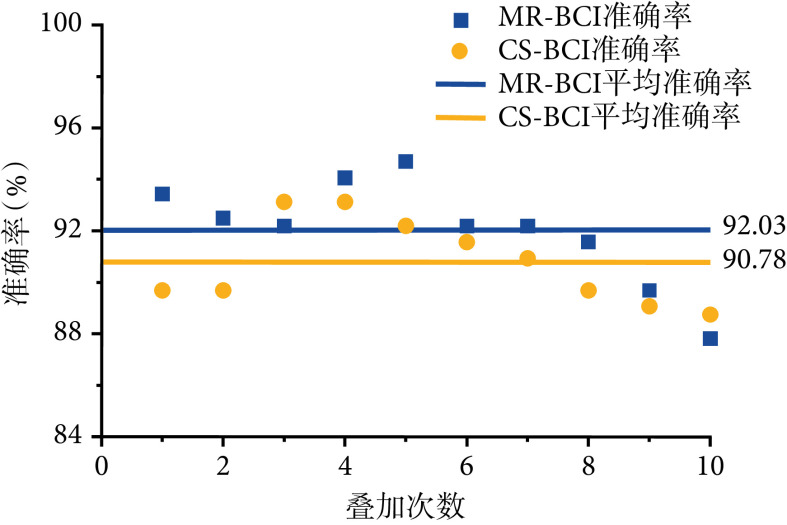

为了对系统的可靠性进行评估,对每名受试者每次试验的前5次叠加平均执行留一法策略。图10表明,MR-BCI和CS-BCI系统使用CNN方法的平均识别准确率分别为92.03%和90.78%。实验结果表明尽管交叉验证集有所不同,但性能是稳定的。实验结束后对受试者的感受进行统计,两名受试者在实验结束后反映同时佩戴视力矫正眼镜和MR眼镜有明显的不适感;两名受试者反映长时间佩戴MR眼镜易产生疲劳,导致实验后期注意力有所下降;一名受试者表示开始佩戴MR眼镜时会有短暂的眩晕感。实验结果表明,两个系统在个体间的差异不大,大部分受试者被MR环境的视觉刺激所吸引,但是长时间的视觉刺激易引起视觉疲劳。

图 10.

The accuracy of MR-BCI and CS-BCI was verified by Leave-One-Out Cross Validation

留一法验证MR-BCI和CS-BCI的准确率

3.3. 系统的实时性分析

对系统的测试发现,由于MR-BCI和CS-BCI系统的数据传输方式有差异,导致MR-BCI系统存在延时抖动,我们通过获取时间戳做差值的方法计算出Hololens2与脑电采集设备之间的无线传输时间误差约为50 ms。这使得MR-BCI数据采集的过程不稳定,致使数据质量降低且与CS-BCI系统数据具有相位差异。根据r2值的结果调整特征提取的时间范围,可以有效地提高无线传输延时抖动引发的ERP成分出现晚的问题,同时可以防止模型过多地学习无效特征。离线实验后又对系统进行了在线测试,在线实验要求每名受试者拼写10个字符,每个字符进行5次试验。结果显示MR-BCI系统的在线准确率和ITR分别为95.2%和27.3 bit/min,相较CS-BCI分别提高了1.4%和0.7 bit/min,两个系统在线实验的性能相似。

表1[18-23]为HMD呈现P300范式的相关研究,大部分文献仅采用HMD作为范式呈现设备来提高便携性,但是没有开发出真正的可穿戴式BCI系统。本研究分别从设备、正确率、输出速度等方面与文献比较。受试者数量决定系统的普适性,通道数量决定受试者的舒适度,本研究的受试者数量较多,同时使用的电极数量较少。本文使用轻量化CNN优化了文献中使用的传统机器学习分类方法。

表 1. HMD presents literature information on the P300 paradigm.

HMD呈现P300范式的文献信息

| 研究作者 | 设备 | 平均正确率 | 速度 | 受试者数量/通道数量 | 分类方法 |

| 文献[19] | AR/CS | 80% | 2.34个/min | 4/16 | Fisher线性判别分析 |

| 文献[20] | AR | 76%/87.2% | 每9 s/24.75 s输出一个指令 | 8/15 | Fisher线性判别分析 |

| 文献[21] | AR/CS | 80% | 1.18 bit/min | 9/- | 核函数支持向量机 |

| 文献[22] | VR | 70%以上 | 1个/5 s | 6/16 | 支持向量机分类器 |

| 文献[23] | AR/CS | 86.1%/81.1% | 1个/6.5 s | 5/4 | 逐步线性判别分析 |

| 文献[18] | VR | 75% | 20.1 bit/min | 21/16 | 黎曼最小距离均值分类器 |

| 本研究 | MR/CS | 95.2% | 27.3 bit/min | 16/7 | 低计算复杂度的CNN |

4. 结论

本研究以Hololens2作为范式呈现设备、OpenBCI作为脑电采集设备、Jetson Nano嵌入式计算机作为数据处理设备设计了一套可穿戴的P300字符拼写系统,并与传统的CS-BCI系统进行比较。与CS-BCI相比,MR-BCI系统的分类准确率和ITR相近并且有所提高。同时本系统提出了一种适用于小数据集的CNN分类方法,该方法可以应用到低算力的嵌入式计算机中。本文设计的可穿戴式MR-BCI与文献中HMD结合P300的BCI系统相比具有较高的性能。未来,MR-BCI系统将结合更多的外部设备用于辅助残疾患者与外部世界进行沟通。

重要声明

利益冲突声明:本文全体作者均声明不存在利益冲突。

作者贡献声明:李奇主要负责实验指导、数据处理和分析指导以及论文审阅修订;张庭嘉主要负责实验设计、数据处理和分析以及初稿撰写;宋雨和刘玉龙主要负责统筹项目推进、数据分析指导、论文审阅修订以及设备支持;孙美琪主要负责数据采集以及论文审阅修订。

伦理声明:本研究通过了长春理工大学伦理委员会的审批。

Funding Statement

吉林省科技发展计划国际联合研究中心建设项目(20200802004GH)

References

- 1.Collaborators G A systematic analysis for the global burden of disease study 2017. Lancet. 2018;392(10159):1789–1858. doi: 10.1016/S0140-6736(18)32279-7. [DOI] [PMC free article] [PubMed] [Google Scholar]

- 2.Sellers E W, Donchin E A P300-based brain-computer interface: initial tests by ALS patients. Clin Neurophysiol. 2006;117(3):538–548. doi: 10.1016/j.clinph.2005.06.027. [DOI] [PubMed] [Google Scholar]

- 3.Mcfarland D J, Wolpaw J R EEG-based brain-computer interfaces. Curr Opin Biomed Eng. 2017;4:194–200. doi: 10.1016/j.cobme.2017.11.004. [DOI] [PMC free article] [PubMed] [Google Scholar]

- 4.Abootalebi V, Moradi M H, Khalilzadeh M A A comparison of methods for ERP assessment in a P300-based GKT. Int J Psychophysiol. 2006;62(2):309–320. doi: 10.1016/j.ijpsycho.2006.05.009. [DOI] [PubMed] [Google Scholar]

- 5.Dien J, Spencer K M, Donchin E J P Parsing the late positive complex: mental chronometry and the ERP components that inhabit the neighborhood of the P300. Psychophysiology. 2004;41(5):665–678. doi: 10.1111/j.1469-8986.2004.00193.x. [DOI] [PubMed] [Google Scholar]

- 6.Schembri P, Pelc M, Ma J The effect that auditory distractions have on a visual P300 speller while utilizing low-cost off-the-shelf equipment. Computers. 2020;9(3):68. doi: 10.3390/computers9030068. [DOI] [Google Scholar]

- 7.Qin Z, Li Q High rate BCI with portable devices based on EEG. Smart Health. 2018;9:115–128. [Google Scholar]

- 8.Kerous B, Liarokapis F. BrainChat—A collaborative augmented reality brain interface for message communication// Proceedings of the 2017 IEEE International Symposium on Mixed and Augmented Reality (ISMAR-Adjunct). Nantes: IEEE, 2017: 279-283.

- 9.Ke Y F, Liu P X, An X W, et al An online SSVEP-BCI system in an optical see-through augmented reality environment. J Neural Eng. 2020;17(1):160–166. doi: 10.1088/1741-2552/ab4dc6. [DOI] [PubMed] [Google Scholar]

- 10.Zhu D, Zhou X, Guo Q. An identification system based on portable EEG acquisition equipment// Proceedings of the 2013 Third International Conference on Intelligent System Design and Engineering Applications. Hong Kong: IEEE, 2013: 281-284.

- 11.Chen S C, Hsieh S C, Liang C K. An intelligent brain computer interface of visual evoked potential EEG// 2008 Eighth International Conference on Intelligent Systems Design and Applications. Kaohsuing: IEEE, 2008: 343-346.

- 12.Frey J. Comparison of a consumer grade EEG amplifier with medical grade equipment in BCI applications// Proceedings of the International BCI meeting. New York: IEEE, 2016: hal-01278245.

- 13.Lu Z H, Li Q, Gao N, et al Happy emotion cognition of bimodal audiovisual stimuli optimizes the performance of the P300 speller. Brain Behav. 2019;9(12):e01479. doi: 10.1002/brb3.1479. [DOI] [PMC free article] [PubMed] [Google Scholar]

- 14.Ramirez-Quintana J A, Madrid-Herrera L, Chacon-Murguia M I, et al Brain-computer interface system based on p300 processing with convolutional neural network, novel speller, and low number of electrodes. Cogn Comput. 2021;13(1):108–124. doi: 10.1007/s12559-020-09744-2. [DOI] [Google Scholar]

- 15.Thompson D E, Blain-Moraes S, Huggins J E Performance assessment in brain-computer interface-based augmentative and alternative communication. BioMed Eng OnLine. 2013;12(1):43. doi: 10.1186/1475-925X-12-43. [DOI] [PMC free article] [PubMed] [Google Scholar]

- 16.Gao F, Cao B, Cao Y, et al Electrophysiological evidence of separate pathways for the perception of depth and 3D objects. Int J Psychophysiol. 2015;96(2):65–73. doi: 10.1016/j.ijpsycho.2015.03.003. [DOI] [PubMed] [Google Scholar]

- 17.Cauquil A S, Trotter Y, Taylor M J At what stage of neural processing do perspective depth cues make a difference? Exp Brain Res. 2006;170(4):457–463. doi: 10.1007/s00221-005-0229-1. [DOI] [PubMed] [Google Scholar]

- 18.Cattan G, Andreev A, Mendoza C, et al A comparison of mobile VR display running on an ordinary smartphone with standard PC display for P300-BCI stimulus presentation. IEEE T Games. 2019;13(1):68–77. [Google Scholar]

- 19.Lenhardt A, Ritter H. An augmented-reality based brain-computer interface for robot control// Proceedings of the Neural Information Processing Models and Applications—17th International Conference (ICONIP). Sydney: APNNS, 2010: 58-65.

- 20.Kouji T, Naoki H, Kenji K Towards intelligent environments: An augmented reality–brain–machine interface operated with a see-through head-mount display. Front Neurosci-Switz. 2011;5:60. doi: 10.3389/fnins.2011.00060. [DOI] [PMC free article] [PubMed] [Google Scholar]

- 21.Uno K, Naito G, Tobisa Y, et al Basic investigation of brain–computer interface combined with augmented reality and development of an improvement method using the nontarget object. Electr Commun Jap. 2015;98(8):9–15. doi: 10.1002/ecj.11715. [DOI] [Google Scholar]

- 22.Rohani D A, Puthusserypdy S BCI inside a virtual reality classroom: a potential training tool for attention. EPJ NBP. 2015;3(1):1–14. [Google Scholar]

- 23.Zhong S, Liu Y, Yu Y, et al A dynamic user interface based BCI environmental control system. Int J Hum-Comput Int. 2020;36(1):55–66. doi: 10.1080/10447318.2019.1604473. [DOI] [Google Scholar]