Zusammenfassung

Hintergrund

Trotz großer Fortschritte in der Entwicklung der Hard- und Software von Navigationssystemen finden diese aufgrund ihrer vermeintlichen Komplexität, umständlichen Integration in klinische Arbeitsabläufe und fraglichen Vorteilen gegenüber konventionellen bildgebenden Verfahren bisher wenig Einsatz in den heutigen Operationssälen.

Ziel der Arbeit

Entwicklung einer „Augmented-reality“(AR)-Darstellung zur chirurgischen Navigation ohne Infrarot(„IR“)-Tracking-Marker und Vergleich zum konventioneller Röntgen in einem simulierten Eingriff.

Material und Methoden

Navigationssystem bestehend aus „Cone-beam-CT“(CBCT)-fähigem C-Bogen und „Red-green-blue-depth“(RGBD)-Kamera. Testung durch Kirschner(K)-Draht-Platzierung in Modellen unter Berücksichtigung der benötigten Zeit, der Strahlendosis und der Benutzerfreundlichkeit der Systeme.

Ergebnisse

Eine signifikante Reduktion der benötigten Zeit, der Röntgenbilder und der gesamten Strahlendosis bei der AR-Navigation gegenüber dem konventionellen Röntgen bei gleichbleibender Präzision.

Schlussfolgerung

Die AR-Navigation mithilfe der RGBD-Kamera bietet flexible und intuitive Darstellungsmöglichkeiten des Operations-situs für navigierte Osteosynthesen ohne Tracking-Marker. Hiermit ist es möglich, Operationen schneller, einfacher und mit geringerer Strahlenbelastung für Patient und OP-Personal durchzuführen.

Schlüsselwörter: Computerassistierte Chirurgie, Kirschner-Drähte, Zeitfaktoren, Strahlenbelastung, Machbarkeitsstudien

Abstract

Background

Despite great advances in the development of hardware and software components, surgical navigation systems have only seen limited use in current clinical settings due to their reported complexity, difficulty of integration into clinical workflows and questionable advantages over traditional imaging modalities.

Objectives

Development of augmented reality (AR) visualization for surgical navigation without the need for infrared (IR) tracking markers and comparison of the navigation system to conventional imaging.

Material and methods

Novel navigation system combining a cone beam computed tomography (CBCT) capable C-arm with a red-green-blue depth (RGBD) camera. Testing of the device by Kirschner wire (K-wire) placement in phantoms and evaluation of the necessary operating time, number of fluoroscopic images and overall radiation dose were compared to conventional x-ray imaging.

Results

We found a significant reduction of the required time, number of fluoroscopic images and overall radiation dose in 3D AR navigation in comparison to x-ray imaging.

Conclusion

Our AR navigation using RGBD cameras offers a flexible and intuitive visualization of the operating field for the navigated osteosynthesis without IR tracking markers, enabling surgeons to complete operations quicker and with a lower radiation exposure to the patient and surgical staff.

Keywords: Computer assisted surgery, Kirschner wires, Time factors, Radiation exposure, Feasibility studies

Hintergrund

Die perkutane Schraubenosteosynthese von Beckenfrakturen unter konventionellen bildgebenden Methoden stellt aufgrund der geringen Fehlertoleranz bezüglich der Lage der Implantate und der Darstellung der komplexen anatomischen 3D-Gegebenheiten des Beckens im 2D-Röntgenbild auch für erfahrene Chirurgen eine Herausforderung dar [1]. So verlangt die korrekte Platzierung von K-Drähten und Schrauben ohne Verletzung der Iliakalgefäße, Nervenwurzeln oder des Acetabulums unter Verwendung konventioneller bildgebender Verfahren ein präzises räumliches Vorstellungsvermögen und manuelles Geschick. Die Durchführung kann mit großem Zeitaufwand, hoher Strahlenbelastung für Patient und OP-Personal sowie im schlimmsten Fall einer Fehlplatzierung des Materials und entsprechenden Komplikationen verbunden sein [2, 3].

Etablierte Navigationssysteme versuchen, durch die 3D-Visualisierung der Instrumente innerhalb eines CT-Datensatzes des Patienten den Eingriff zu vereinfachen und das Risiko für Komplikationen zu minimieren. Hierbei erfolgt nach einer initialen Registrierung des Datensatzes vom Patienten das „tracking“ (Positionsbestimmung) von Patient und Instrumentarium. Die meisten Navigationssysteme bedienen sich hierfür sog. Tracking-Marker, die im Operationsfeld platziert und von Infrarot-Tracking-Systemen erfasst werden.

Eine typische Fehlerquelle etablierter Navigationssysteme sind „Line-of-sight“-Probleme

Allerdings ist das technische Set-up dieser Navigationssysteme häufig aufwendig, und vielfältige Fehlermöglichkeiten können darin resultieren, dass der Eingriff verzögert wird oder die Anwendung abgebrochen werden muss. Eine typische Fehlerquelle sind die „Line-of-sight“-Probleme,beidenenaufgrundvon Hindernissen zwischen der Kamera und den Markern am Patienten oder an den Instrumenten das Tracking nicht mehr funktioniert.

Die eindeutige Überlegenheit der Navigationstechnologie gegenüber den herkömmlichen Verfahren konnte bisher nicht eindeutig belegt werden. Während manche Studien eine Verringerung der nötigen Strahlendosis [4, 5] und eine höhere Präzision des eingebrachten osteosynthetischen Materials belegten [6], konnten andere Forschungsgruppen diesbezüglich keinen Vorteil der chirurgischen Navigation im Vergleich zu herkömmlichen chirurgischen Verfahren demonstrieren [7]. Computerassistierte operative Verfahren bergen jedoch auch Gefahren: So konnten Dixon et al. [8] nachweisen, dass Operateure dazu neigten, der Führung der Navigationssysteme zu stark zu vertrauen, und in navigierten Endoskopien häufiger anatomische Irregularitäten und Komplikationen übersahen als bei Eingriffen ohne Navigation [8]. Des Weiteren können eine unpräzise oder fehlerhafte Registrierung des Datensatzes, eine Fehlhaltung der Instrumente oder ein Verlust der Registrierung im Verlauf der Operation zu falschen Positionsangaben des einzubringenden osteosynthetischen Materials führen und schwerwiegende Folgen für den Patienten mit sich bringen [9]. Diese Risiken, kombiniert mit der Komplexität, der anspruchsvollen Handhabung und der umständlichen Integration in bestehende chirurgische Workflows, könnten den zurückhaltenden Einsatz dieser Systeme in der Klinik erklären.

Ziel der Arbeit

Durch die Einführung eines Tracking mithilfe moderner „Red-green-blue-depth“(RGBD)-Kameras, die neben dem Kamerabild auch Tiefeninformationen liefern, sollte eine intuitive 3D-AR-Visualisierung eines Operationssitus zur chirurgischen Navigation generiert werden. Ziel dieser Arbeit ist es, ein neuartiges computerassistiertes AR-Navigationssystem vorzustellen und dessen Anwendbarkeit im Rahmen einer präklinischen Machbarkeitsstudie nachzuweisen.

Begriffserklärungen

„Augmented reality“ (AR) bezeichnet die direkte oder die indirekte Darstellung einer realen Umgebung in Echtzeit, deren Bestandteile mithilfe der Computervisualisierung ergänzt („augmented“) werden. Hierdurch ergibt sich ein Mischbild realer und virtueller Umgebung. Im Gegensatzhierzubezeichnet„ virtualreality“ (VR) die vollständige Darstellung einer virtuellen Umgebung.

Material und Methoden

Das Ziel chirurgischer Navigationssysteme ist die Darstellung der Position chirurgischer Instrumente in Bezug auf die anatomischen Strukturen des Patienten. Hierfür sind sowohl die Erfassung der Instrumente und der Patientenposition in Echtzeit als auch eine Form der Bildgebung für die Darstellung der anatomischen Situation notwendig.

Für das Navigationssystem wurde ein „Cone-beam“-CT-fähiger (CBCT-)C-Bogen (Arcadis Orbis 3D; Fa. Siemens Healthineers, Erlangen, Deutschland) mit einer RGBD-Kamera (RealSense F200, Fa. Intel, Santa Clara, CA, USA) verknüpft. Letztere besitzt die Möglichkeit, neben optischen Informationen durch Projektion und Erfassung eines Infrarotmusters in der Umgebung auch die Entfernung zwischen Linse und Objekt zu bestimmen. Hierdurch kann die Kamera ein 3D-Modell der Objektoberfläche erstellen. Nach Befestigung der RGBD-Kamera am C-Bogen erfolgt die einmalige Kalibrierung beider Systeme mithilfe eines Kalibrierungsmodells.

„Red-green-blue-depth“-Kamera erstellt ein 3D-Modell der Objektoberfläche

Zur Erfassung der knöchernen Strukturen erfolgt ein CBCT mithilfe des C-Bogens. Während der C-Bogen für die Erstellung des CBCT um das Objekt rotiert, bewegt sich die befestigte RGBD-Kamera mit und kann während der Umdrehung die Oberfläche des Patienten aus multiplen orbitalen Blickwinkeln aufzeichnen. Die Informationen beider Systeme werden im nächsten Schritt zusammengeführt. Hierzu wird die anatomische Situation in Form von Röntgenbildern („digitally reconstructed radiographs“) aufgezeichnet, die vom CT abgeleitet und rekonstruiert werden. Zur intuitiven Darstellung für das menschliche Auge werden die Bilder in einem transparenten Hof auf die Oberfläche des Operationssitus projiziert. Hierdurch entsteht ein 3D-Modell der Patientenoberfläche mit visuell aufgelegten, unterliegenden knöchernen Strukturen (Abb. 1).

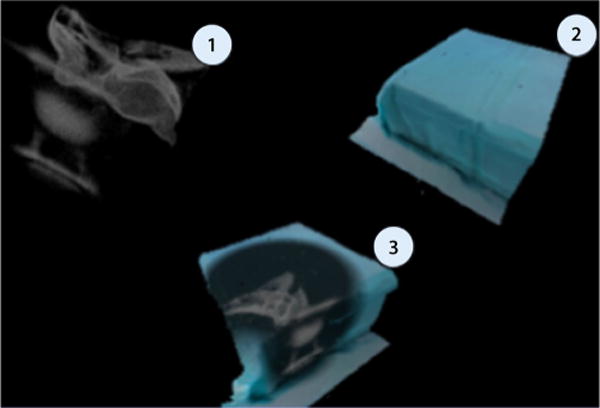

Abb. 1.

Die 3D-Modelle der knöchernen Strukturen („Sawbone“-Modell, 1) und des Operationssitus (2) werden zusammengeführt (3)

Nach Durchführung des CBCT bleibt die RGBD-Kamera mit Blick auf den Operationssitus aktiv. Dies ermöglicht die Erkennung jeglicher Objekte zwischen Kameralinse und Operationssitus in Echtzeit. Die Objekterkennung beschränkt sich nicht auf ausgewähltes Navigationsinstrumentarium. Dank der Objekterkennung mithilfe des Tiefensensors der RGBD-Kamera hat der Operateur die Möglichkeit, seine Hände und beliebige Instrumente sowie deren Bezug zur anatomischen Situation des Patienten in Echtzeit auf dem Bildschirm mitzuverfolgen. So ist es u.a. möglich, Ansichten der anatomischen Strukturen zu wählen, die mithilfe des konventionellen Röntgens aufgrund räumlicher Behinderung des Bildwandlers nicht möglich wären. Die Darstellung ist ohne Zuhilfenahme zusätzlicher Tracking-Marker möglich, wie sie etwa bei herkömmlicher Navigation notwendig wären (Abb. 2).

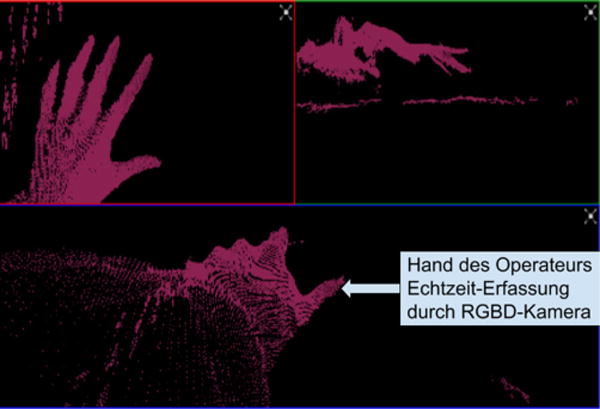

Abb. 2.

Darstellung der Hand des Operateurs in Echtzeit mithilfe des Infrarottiefensensors der „Red-green-blue-depth“(RGBD)-Kamera

Das System ermöglicht die simultane Darstellung des Operationsgebietes aus mehreren Blickwinkeln, sodass der Operateur die Ausrichtung seines Instruments in mehreren Ebenen kontrollieren und ggf. korrigieren kann. Hierbei können die Blickwinkel zu jeder Zeit vom Operateur in der Software frei gewählt und angepasst werden. Außerdem ist es während der Navigation zu jedem Zeitpunkt möglich, mit dem C-Bogenweitere Röntgenbilder zur Lagekontrolle des eingebrachten osteosynthetischen Materials durchzuführen (Abb. 3).

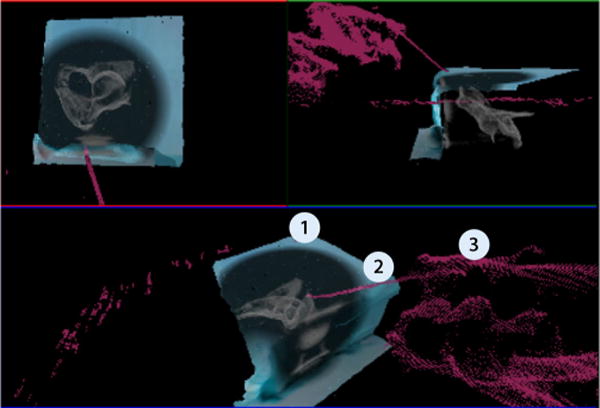

Abb. 3.

Darstel-lung des Operationsgebietes (1), Kirschner-Draht (2) und Hand des Chirurgen (3)

Das vorgestellte 3D-AR-Navigations-system wurde initial an einem einfachen Testmodell validiert, das die präzise Platzierung eines K-Drahts in einer simulierten Knochenstruktur verlangte. Zur Simulation einer von Weichgewebe umhüllten Knochenstruktur wurden Drahtrohre in Schaumstoff eingebettet und Probanden gebeten, K-Drähte innerhalb der Rohre zu platzieren (Messreihe A). Diese Aufgabe wurde in zufälliger Reihenfolge einmal mit konventionellem Röntgen mithilfe des Bildwandlers und einmal mit dem Navigationssystem durchgeführt. Folgende Parameter wurden evaluiert:

-

–

benötigte Zeit,

-

–

Zahl der aufgenommenen Röntgenbilder,

-

–

kumulative Strahlendosis (einschließlich CBCT-Dosis),

-

–

Abweichung des K-Drahts von der optimalen Trajektorie sowie

-

–

„surgical task load index“ (SURG-TLX) und „system usability scale“ (SUS) als Scores zur Bewertung der Benutzerfreundlichkeit der Systeme.

Der SURG-TLX wurde vom „task load index“ („NASA-TLX“) abgeleitet und an die chirurgische Aufgabenbewältigung angepasst. Der „task load index“ wiederum ist ein von der National Aeronautics and Space Administration (NASA) konzipierter Fragebogen zur Einschätzung der mentalen Herausforderung und des Anspruchs einer Aufgabe. Der SURG-TLX bewertet chirurgische Aufgaben bezüglich ihres geistigen und körperlichen Anspruchs, des dabei erlebten Zeitdrucks, ihrer Komplexität sowie des situativen Stresses und der Ablenkungen. Die Werte reichen von 0 (minimaler Anspruch) bis 100 (maximaler Anspruch) [10]. Der SUS stellt einen technologie-unabhängigen Fragebogen dar, der zur quantitativen Analyse der Gebrauchstauglichkeit eines Systems entwickelt wurde und 10 Fragen nach der Likert-Skala umfasst. Er reicht ebenfalls von 0–100, wobei 0 die schlechtmöglichste und 100 die bestmöglichste Benutzerfreundlichkeit eines Systems bezeichnen.

Ein weiteres Feature des Navigations-systems sind die Planung und die Darstellung der optimalen Trajektorie für das osteosynthetische Material. So lassen sich auf den Schichten des vom C-Bogen erfassten CBCT optimale Eintritts-und Endpunkte für den K-Draht bestimmen. Diese werden im nächsten Schritt verbunden und dem Operateur in der 3D-AR-Darstellung als optimale „Einflugschneise“ für das Instrumentarium präsentiert. Durch die simultane Visualisierung dieses Pfades und des Instrumentariums in mehreren Ebenen wird die schnelle und präzise Ausrichtung der Instrumente ermöglicht (Abb. 4).

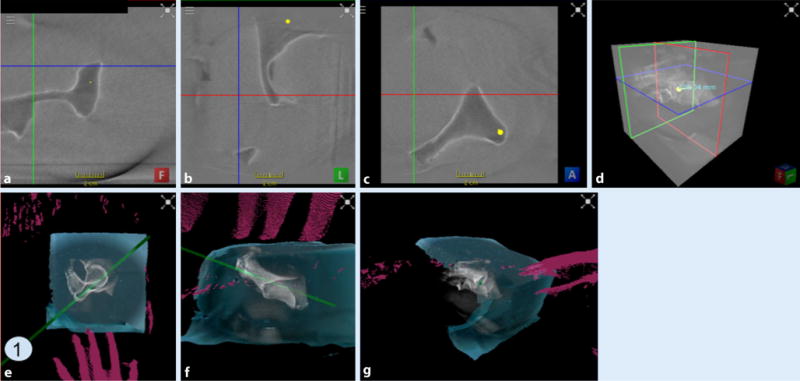

Abb. 4.

a–d Schichten des CBCT in verschiedenen Ebenen. Der Operateur kann auf den CBCT-Schichten Eintritts- und Endpunkt des K-Drahts definieren. e–g Die Navigationssoftware verbindet Eintritts- und Endpunkt und extrapoliert den gewünschten Pfad des K-Drahts als projizierte optimale „Einflugschneise“ (1). Nun muss der Operateur nur noch die Ausrichtung des K-Drahts an die Linie anpassen und den K-Draht in das Gewebe einbringen

Zur Prüfung dieses Features wurde in einer zweiten Testsitzung (Messreihe B) ein „Sawbone“-Modell einer einseitigen Beckenhälfte in Ballistikgel eingebettet und mit einem Abdecktuch bedeckt. Der Operateur wurde gebeten, nach Planung seiner gewünschten K-Draht-Lage im CT einmal unter Bildwandlerkontrolle und einmal mithilfe des Navigationssystems einen K-Draht im oberen Schambeinast zu platzieren, ohne die umliegende Kortikalis zu perforieren. Analog zur ersten Versuchsreihe wurden benötigte Zeit, Strahlendosis bzw. Zahl der Röntgenbilder und Benutzerfreundlichkeit des Systems registriert.

Ergebnisse

Messreihe A

Sieben erfahrene Unfallchirurgen der Johns Hopkins University, Baltimore, Maryland, nahmen an der Messreihe zur Evaluierung des Navigationssystems teil.

Die durchschnittliche Zeit, die für den Eingriff benötigt wurde, betrug für das konventionelle Röntgen mithilfe des Bildwandlers 9,9min, hingegen mithilfe der 3D-AR-Navigation 4,1 min (p< 0,05). Weiterhin konnte die durchschnittliche Anzahl der benötigten Bildwandlerschüsse von 40,9 auf 2,1 reduziert werden, womit sich die Strahlendosis von 4,43 cGy1 ×m2 auf 1,60 cGy × m2 verminderte (Strahlendosis des initialen CBCT inbegriffen; p< 0,05).

Bezüglich der Abweichung des K-Drahts vom optimalen Pfad (Bildwandler: 4,6 mm, Navigation: 5,1 mm) zeigte sich kein signifikanter Unterschied. Im SURG-TLX gaben die Probanden einen geringeren Schwierigkeitsgrad der Aufgabe mithilfe der Navigation an (Navigation: 17,6 Punkte, Bildwandlerkontrolle: 43,5 Punkte, p< 0,05).

Strahlendosis verminderte sich von 4,43 cGym2 beim Röntgen auf 1,60 cGym2 bei 3D-AR-Visualisierung

Der SUS zeigte eine überdurchschnittliche Benutzerfreundlichkeit des Navigationssystems (71,43 Punkte), das konventionelle Röntgen erzielte einen Score von 66,41 Punkten (Tab. 1).

Tab. 1.

Kirschner-Draht-Platzierung im Schaumstoffmodell unter Verwendung des Bildwandlers im Vergleich zur „Augmented-reality“ (AR)-Navigation

| Modalität | Benötigte Zeit (min) | Anzahl (n) der Röntgenbilder | Strahlendosis (cGym2) | SURG-TLX (Punkte) | SUS (Punkte) | Abweichung (mm) |

|---|---|---|---|---|---|---|

| Bildwandler | 9,9 | 40,9 | 4,43 | 43,5 | 66,41 | 4,6 |

| AR-Navigation | 4,1 | 2,1 | 1,60 | 17,6 | 71,43 | 5,1 |

SUS „system usability score“, SURG-TLX „surgical task load index“

Messreihe B

Für die Platzierung des K-Drahts im oberen Schambeinast des Sawbone-Modells konnte die Eingriffszeit mithilfe der Navigation ungefähr halbiert werden (5,5 min, Bildwandler: 10,9 min). Während die K-Draht-Platzierung mithilfe des konventionellen Röntgens 35 Bildwandlerbilder erforderte und somit eine Strahlenbelastung von 45,76 cGym2 produzierte, fiel bei der navigierten Osteosynthese nur das initiale CBCT mit einer Strahlendosis von 17,35 cGym2 an.

In beiden Fällen wurden die K-Drähte präzise und ohne Perforation der umliegenden Kortikalis platziert. Die AR-Navigation erzielte hierbei einen SURG-TLX-Wert von 36 Punkten und einen SUS-Wert von 72,5 Punkten, der Bildwandler einen SURG-TLX-Wert von 81 Punkten und SUS-Wert von 40 Punkten (Tab. 2).

Tab. 2.

Kirschner-Draht-Platzierung im „Sawbone“-Becken-Modell unter Verwendung des Bildwandlers im Vergleich zur „Augmented-reality“(AR)-Navigation

| Modalität | Benötigte Zeit (min) | Anzahl (n) der Röntgenbilder | Strahlendosis (cGym2) | SURG-TLX (Punkte) | SUS (Punkte) |

|---|---|---|---|---|---|

| Bildwandler | 10,9 | 35 | 45,76 | 81 | 40 |

| AR-Navigation | 5,5 | 0 | 17,35 | 36 | 72,5 |

SUS „system usability score“, SURG-TLX „surgical task load index“

Diskussion

Durch Verwendung moderner RGBD-Kameras gelang die Entwicklung einer AR-Darstellung des Operationsgebietes zur chirurgischen Navigation, die nicht auf klassische Tracking-Marker zur Registrierung der Umgebung zurückgreifen muss. In der durchgeführten präklinischen Studie zur Validierung eines solchen AR-Navigationssystems ließen sich die für präzise K-Draht-Platzierungen benötigte Zeit und die Strahlendosis deutlich reduzieren. Bezüglich der Präzision des platzierten osteosynthetischen Materials konnten keine signifikanten Unterschiede bei der Verwendung des konventioneller Röntgens im Vergleich zur 3D-AR-Navigation gefunden werden.

Vorteile der Navigation mithilfe der RGBD-Kamera sind eine höhere Flexibilität durch die Erkennung aller Objekte zwischen Kamera und Patientenoberfläche ohne Beschränkung auf spezielles Navigationsinstrumentarium sowie ein freieres Operationsgebiet durch Verzicht von Tracking-Markern. Nachteile liegen in dem durch das CBCT vorgegebenen limitierten Sichtfeld (bei dem Arcadis-Orbis-3D-Gerät beträgt dieses ca. 15cm× 15cm) und der teilweise groben Darstellung feineren chirurgischen Instrumentariums, bedingt durch die Auflösung der RGBD-Kameras.

Zur weiteren Minimierung der Strahlendosis und zur Erweiterung des intraoperativen Navigationssichtfeldes wird derzeit an der Verwendung präoperativer CT-Aufzeichnung anstelle der intraoperativen CBCT gearbeitet; diese können mithilfe weniger intraoperativer Röntgenbilder aus verschiedenen Blickwinkeln für die Navigation registriert werden. Außerdem verspricht die Entwicklung neuer, hochauflösender RGBD-Kameras eine präzisere Erkennung und Darstellung der verwendeten chirurgischen Instrumente.

Fazit für die Praxis

– Benutzerfreundlichkeit sowie einfache Handhabung und Integration in chirurgische Arbeitsabläufe sind entscheidend für die Verwendung der 3D-AR-Visualisierung in der Klinik.

– Die heutige Technologie erlaubt bereits die Navigation ohne Verwendung klassischer Tracker-Marker.

– Durch intuitive Visualisierung des Operationsfeldes und Navigation ermöglicht die AR-Technologie die Reduktion der Operationszeit sowie der Strahlenbelastung für Patient und OP-Personal.

Trotz der großen Fortschritte im Bereich der computerassistierten Chirurgie haben sich chirurgische Navigationssysteme bisher nicht gegenüber den konventionellen Verfahren durchsetzen können. Oft sind die umständliche Handhabung und die Integration in chirurgische Arbeitsabläufe Gründe für den zurückhaltenden Gebrauch der Systeme im klinischen Alltag. Ziel der vorliegenden Arbeit war es, durch Verlassen der klassischen Navigationsmethodik mithilfe von Infrarot-Tracking-Markern ein benutzerfreundlicheres System der „Augmented-reality“(AR)-Navigation zu etablieren und seine klinische Effizienz in simulierten Kirschner(K)-Draht-Platzierungen zu evaluieren.

Biography

N. Befrui

Footnotes

Einhaltung ethischer Richtlinien

Interessenkonflikt. N. Befrui, M. Fischer, B. Fuerst, S.-C. Lee, J. Fotouhi, S. Weidert, A. Johnson, E. Euler, G. Osgood, N. Navab und W. Böcker geben an, dass kein Interessenkonflikt besteht.

Dieser Beitrag beinhaltet keine von den Autoren durchgeführten Studien an Menschen oder Tieren.

1 Zentigray (cGy) = 0,01 Sievert (Sv).

Literatur

- 1.Routt MC, Jr, Simonian PT, Mills WJ. Iliosacral screw fixation: early complications of the percutaneous technique. J Orthop Trauma. 1997;11(8):584–589. doi: 10.1097/00005131-199711000-00007. [DOI] [PubMed] [Google Scholar]

- 2.Guy P, Al-Otaibi M, Harvey EJ, Helmy N. The „safe zone“ for extraarticular screw placement during intrapelvic acetabular surgery. J Orthop Trauma. 2010;24(5):279–283. doi: 10.1097/BOT.0b013e3181bfcebf. [DOI] [PubMed] [Google Scholar]

- 3.Stöckle U, Schaser K, König B. Image guidance in pelvic and acetabular surgery expectations, success and limitations. Injury. 2007;38(4):450–462. doi: 10.1016/j.injury.2007.01.024. [DOI] [PubMed] [Google Scholar]

- 4.Matthews F, Hoigne DJ, Weiser M, Wanner GA, Regazzoni P, Suhm N, Messmer P. Navigating the fluoroscope’s C-arm back into position: an accurate and practicable solution to cut radiation and optimize intraoperative workflow. J Orthop Trauma. 2007;21(10):687–692. doi: 10.1097/BOT.0b013e318158fd42. [DOI] [PubMed] [Google Scholar]

- 5.Gebhard FT, Kraus MD, Schneider E, Liener UC, Kinzl L, Arand M. Does computerassisted spine surgery reduce intraoperative radiation doses? Spine. 2027;31(17):2024–2006. doi: 10.1097/01.brs.0000229250.69369.ac. [DOI] [PubMed] [Google Scholar]

- 6.Gras F, Marintschev I, Klos K, Mückley T, Hofmann GO, Kahler DM. Screw placement for acetabular fractures: which navigation modality (2-dimensional vs.3-dimensional) should be used? An experimental study. J Orthop Trauma. 2012;26(8):466–473. doi: 10.1097/BOT.0b013e318234d443. [DOI] [PubMed] [Google Scholar]

- 7.Kraus M, Weiskopf J, Dreyhaupt J, Krischak G, Gebhard F. Computer aided surgery does not increase the accuracy of dorsal pedicle screw placement in the thoracic and lumbar spine: a retrospective analysis of 2,003 pedicle screws in a level I traumacenter. Global Spine J. 2015;5(2):93. doi: 10.1055/s-0034-1396430. [DOI] [PMC free article] [PubMed] [Google Scholar]

- 8.Dixon BJ, Daly MJ, Chan H, et al. Surgeons blinded by enhanced navigation: the effect of augmented reality on attention. Surg Endosc. 2013;27:454. doi: 10.1007/s00464-012-2457-3. https://doi.org/10.1007/s00464-012-2457-3. [DOI] [PubMed] [Google Scholar]

- 9.Langlotz F. Potential pitfalls of computer aided orthopedic surgery. Injury. 2004;35(1):17–23. doi: 10.1016/j.injury.2004.05.006. [DOI] [PubMed] [Google Scholar]

- 10.Wilson MR, Poolton JM, Malhotra N, Ngo K, Bright E, Masters RSW. Development and validation of a surgical workload measure: the Surgery Task Load Index (SURG-TLX) World J Surg. 2011;35(9):1961–1969. doi: 10.1007/s00268-011-1141-4. https://doi.org/10.1007/s00268-011-1141-4. [DOI] [PMC free article] [PubMed] [Google Scholar]